Take-Aways

- Mithilfe von Technologie aus dem Bereich der künstlichen Intelligenz (KI) können Signale interpersoneller Interaktion so interpretiert werden, dass eine Zuordnung zu bestimmten Wertesystemen (Tribes) möglich ist. Grundlage sind sogenannte «Signale der Ehrlichkeit».

- Über solche Zuordnungen können Aussagen darüber getroffen werden, wie sich Menschen in Teamarbeit oder soziale Netzwerke einbringen und wie leistungsfähig sie sind.

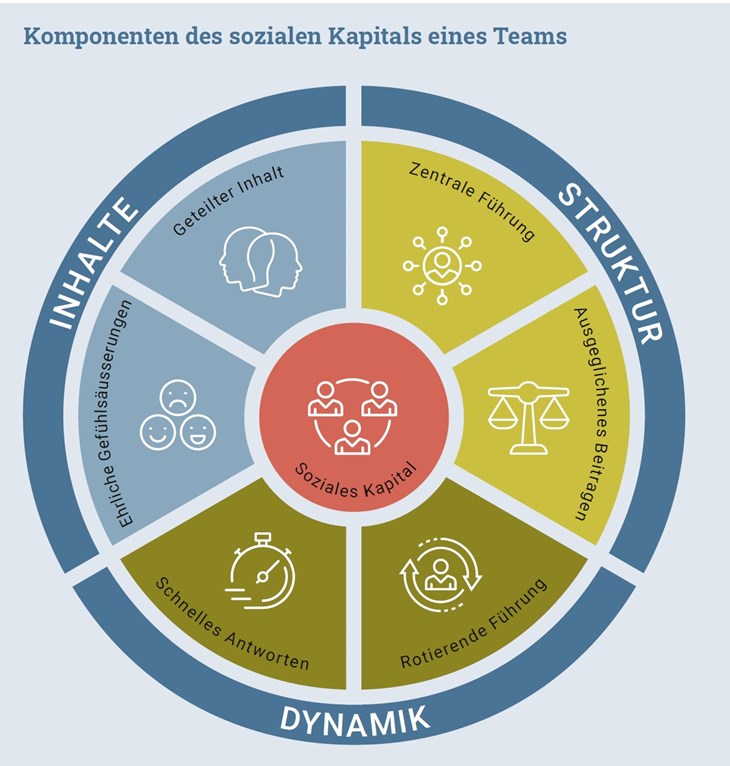

- Bezogen auf ein gesamtes Team oder Netzwerk geht es um die Analyse des sozialen Kapitals, das Teamdynamik, Leadership, Inhalte, ethische Grundhaltungen und Emotionen umfasst.

- Gemessen werden Emotionen und Einstellungen über die KI-basierte Analyse von Mimik, Körpersprache, Körperfrequenzen, Sprech- und Schreibweisen. Die Messungen werden über Videoerfassung, Pflanzen als Biosensoren, Smart-Watches und diverse Software durchgeführt.

Gloor beschäftigt sich mit der Frage, wie Innovationsteams funktionieren, die kreative Höchstleistungen erbringen können. Ziel seiner Forschungsgruppe ist es, Teams und Menschen Spiegel vorzuhalten, wenn es darum geht, ihre Persönlichkeiten, ihre ethischen Einstellungen, ihre Risikobereitschaft und Teamfähigkeit zu analysieren.

In über zwanzigjähriger Forschungsarbeit wurden verschiedene Tools entwickelt, mit denen Emotionen und Einstellungen gemessen und ausgewertet werden können. Grundlage der künstlichen Intelligenz (KI), mit der Messdaten interpretiert werden, war eine Vielzahl von Daten, aus denen sich die Algorithmen entwickeln liessen, die in diesen Tools zum Einsatz kommen. Beispielsweise wurden Bilddaten von Eistänzern ausgewertet, um Merkmale eines Flow-Zustands in der Interaktion zweier Menschen herauszuarbeiten.

Es gibt unendlich viele Interaktionsmuster, die sich messen lassen: beispielsweise, wie lange man jemandem in die Augen schaut oder Formulierungen in Dialogen wie «Ich will…» im Gegensatz zu «Wir wollen…». Körpersprache, Mimik, Geruch und geschriebene und gesprochene Sprache sind Elemente der Interaktion, die mehr über eine Persönlichkeit verraten, als diese mitunter mitteilen will oder kann, weil ihr bestimmte Eigenschaften vielleicht auch nicht bewusst sind. Die Interpretationen der KI basieren auf aggregierten Mustern. Gloor versicherte jedenfalls dem Publikum, dass die Algorithmen zuverlässige Ergebnisse lieferten. Eine Gesichtserkennung beispielsweise könne zwar Hinweise auf Emotionen liefern, man könne diese ohne Kontext aber nicht mit absoluter Sicherheit konstatieren. «Wenn man aber eine Person beobachtet, die einer anderen Person dabei zusieht, wie sie eine Made isst, kann man anhand der Reaktion der zuschauenden Person sehr sicher feststellen, zu welchem ‹Stamm› sie gehört», erläuterte Gloor. So gebe es Gemeinschaften, in denen mit Ekel reagiert werde, während es in anderen durchaus üblich sei, Maden zu essen und diese sogar als Delikatesse wertzuschätzen. Die Stämme oder Tribes, wie sie in der Forschungsarbeit genannt werden, sind Gruppen von Gleichgesinnten, die ein gemeinsames Verständnis teilen.

Ein weiteres wichtiges Element zum Verständnis des Vorgehens bei der automatisierten Erkennung von Emotionen und Wertsystemen ist das Konzept der «ehrlichen Signale» in der Kommunikation. Dazu berichtete Gloor ein Erlebnis, das er in den 1990er Jahren mit Tim Berners Lee hatte, auf dessen Initiative eine Gruppe von Forschern das World Wide Web entwickelte. Diese Initiative musste diverse Überzeugungshürden überwinden, so dass am Ende der Entwicklung von verschiedenen Akteuren Technologien geschaffen wurden, die das Internet in der heutigen Form mit einer grafischen Benutzeroberfläche überhaupt erst ermöglichten und damit den Informationsaustausch revolutionierten.

Gloor hat das Kommunikationsverhalten von Tim Berners Lee analysiert, um herauszufinden, was er daraus lernen könne. Damals konzentrierte er sich vor allem auf dessen E-Mail-Kommunikation und fand typische Signale der Ehrlichkeit – eines war zum Beispiel ein sehr schnelles Reagieren auf E-Mails, was Leidenschaft und Interesse signalisiert.

Seit nunmehr zwanzig Jahren analysieren KI-Tools E-Mail-Kommunikation. Inzwischen konnte die Analyse auch auf direkte interpersonelle Kommunikation ausgedehnt werden. Das Ziel dieser Messungen sind sogenannte COINs (Collaborative Innovation Networks). Darunter werden Teams oder auch soziale Netzwerke verstanden, die in einer gemeinsamen Verschränkung – einem Flow – besondere, kreative Leistungen erbringen. Um zu dieser Verschränkung zu gelangen, bedarf es bestimmter Grundeinstellungen der Individuen, die die Interaktion im Team oder Netzwerk prägen.

Messmethoden

Für die Forschung wurden spezielle Gadgets entwickelt, um Messdaten zu erfassen. Gloor stellte das sogenannte «Happymeter» vor, eine Smart-Watch, auf der eine spezielle Software läuft, die Emotionszustände über bestimmte Frequenzen im Körper misst. Mit diesen Daten kann man beispielsweise feststellen, ob Menschen einander mögen und miteinander synchron sind.

Als Biosensoren werden auch Pflanzen eingesetzt, da Pflanzen auf Körperbewegungen reagieren. Sie können Stress und andere Emotionen erfassen. Ebenso reagieren sie auf Frequenzen bestimmter Geräusche oder Stimmen.